IA et stagiaires fantômes : quand vos intelligences artificielles violent (involontairement) le droit du travail

IA et stagiaires fantômes : quand vos intelligences artificielles violent (involontairement) le droit du travail

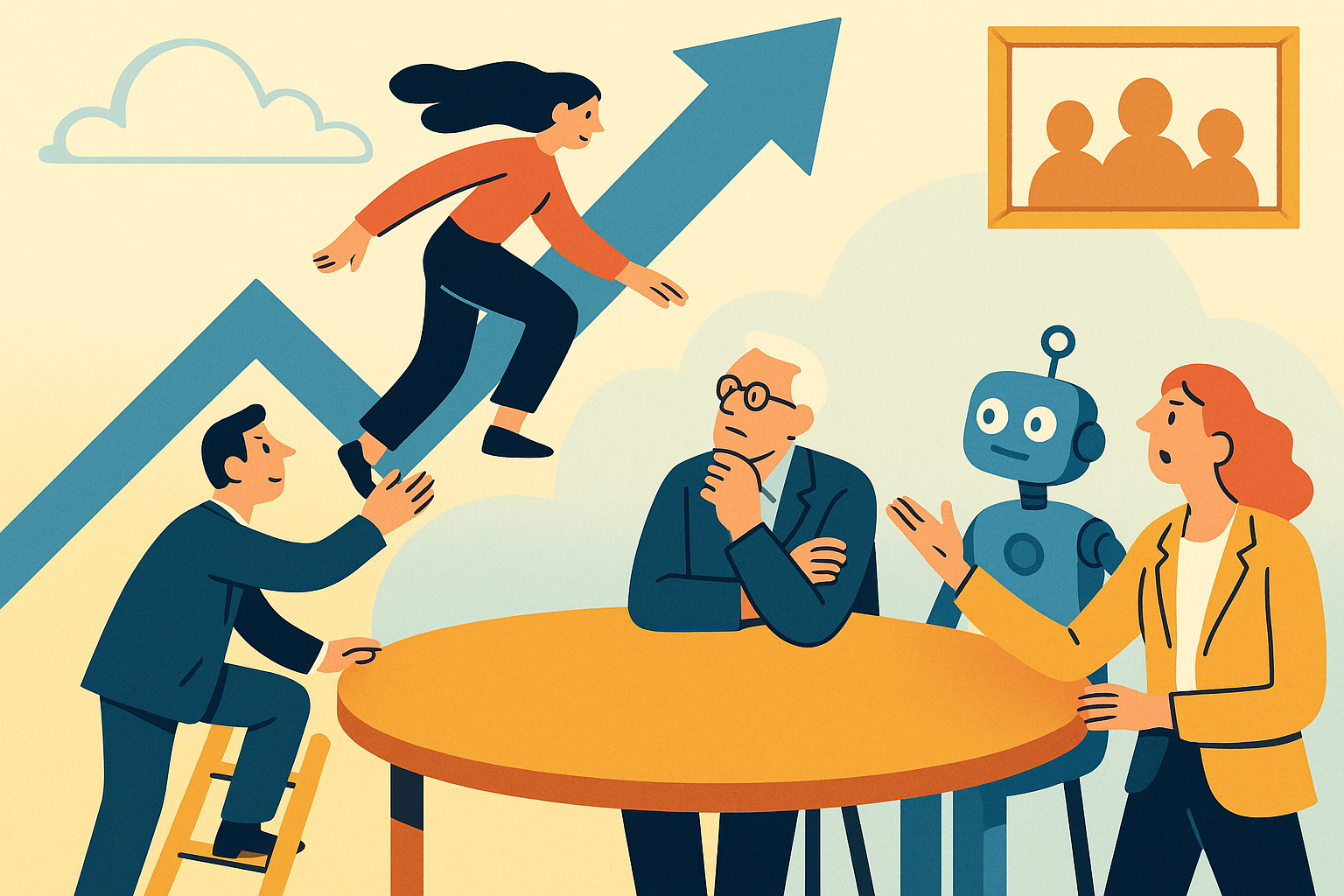

Entre automatisation intelligente et dérive RH, les IA génératives sont parfois traitées comme des stagiaires... sans contrat ni couverture juridique. Danger.

Votre IA travaille-t-elle sans contrat ? Une erreur RH plus fréquente qu’on le croit

En 2024, l’adoption des intelligences artificielles génératives (IA) dans les PME et grandes entreprises françaises ne cesse d'accélérer. ChatGPT, Copilot, Claude ou encore Mistral s'invitent dans les brainstormings créatifs, les analyses de données ou les réponses aux clients. À première vue, une révolution positive.

Mais une erreur fréquente commence à émerger dans les pratiques RH et managériales : traiter ces IA comme des ressources internes à pleine capacité – sans encadrement juridique ni réflexion éthique. Notamment chez les cadres et dirigeants qui intègrent l’IA dans leur quotidien, sans s’interroger sur la protection des données, la responsabilité ou les conditions “de travail” de ces systèmes.

Sans le savoir, certaines directions confient des tâches à l’IA comme à une assistante, un consultant junior... voire un stagiaire officieux. Le problème ? Ces « collaborateurs fantômes » ne sont ni salariés, ni prestataires, ni couverts par un cadre légal défini. Une zone grise très risquée pour l'entreprise.

Quand les intelligences artificielles deviennent des collaborateurs implicites

Le risque n’est pas théorique. En confiant des missions sensibles à une IA générative sans gouvernance claire, l’entreprise peut involontairement :

- exposer des données personnelles ou confidentielles à un outil tiers non conforme au RGPD,

- transmettre du contenu produit par l’IA comme information vérifiée, sans mention ni contrôle,

- ou s’appuyer sur des décisions automatisées biaisées, sans supervision humaine réelle.

En outre, d’un point de vue juridique et social, la question de l’imputabilité du travail réalisé par l’IA reste floue. Qui est responsable si une erreur est commise suite à une consigne de l’IA ? Peut-on la considérer comme co-auteur d’un livrable ? Et si une IA interfère avec un processus RH ou un recrutement, doit-on prévoir des garanties éthiques ?

Certains DRH ou DSI évoquent en souriant leurs “stagiaires IA” pour désigner ChatGPT ou Midjourney… mais cette métaphore soulève une vraie problématique : en tant qu’outil productif intégré aux tâches, l'IA sort du simple cadre d'assistance. Elle participe activement sans statut ni couverture légale.

Cette situation ouvre la voie à une forme d’“externalisation invisible” de tâches sensibles, sans validation juridique. Une dérive potentiellement assimilable à du “travail dissimulé technologique”, en tout cas sur le plan symbolique ou législatif à venir.

Comment encadrer l’usage des IA génératives juridiquement et éthiquement ?

Heureusement, il existe plusieurs leviers pour éviter ces impasses, et intégrer les IA dans l'entreprise de manière responsable :

- Identifier et classifier les cas d’usage réels des IA génératives au sein de vos équipes.

- Distinguer clairement l’IA comme outil (assistance rédactionnelle, synthèse...) de l’IA comme “acteur” impliqué dans les process de décision, modération ou recrutement.

- Sensibiliser les équipes RH, managériales et DSI aux enjeux juridiques et éthiques liés à ces usages.

- Formaliser une gouvernance IA : avec chartes internes, mentions légales, encadrement du traitement des données, et contrat implicite de responsabilité.

- Créer des “limites humaines” : toute recommandation ou livrable généré par IA doit être relu, validé et engagé par un employé identifié.

En d'autres termes, l’usage des intelligences artificielles génératives en entreprise doit entrer dans un cadre juridique sécurisé et éthiquement assumé. Ce n’est ni un gadget, ni un stagiaire numérique. C’est un agent algorithmique dont l’usage engage potentiellement la responsabilité de l’employeur.

C’est pourquoi Certalis propose une formation complète dédiée aux cadres, directions des ressources humaines et dirigeants : Maitriser les aspects juridiques et éthiques de l'intelligence artificielle.

Conçue pour les professionnels en phase d’intégration de l’IA dans leur quotidien, cette formation permet de :

- comprendre le cadre réglementaire actuel autour des IA génératives,

- anticiper les responsabilités de l’entreprise et des individus,

- déployer une gouvernance IA en lien avec vos enjeux métiers,

- et protéger votre organisation des dérives non intentionnelles.

Appel à l’action : Découvrez notre programme de formation Maitriser les aspects juridiques et éthiques de l'intelligence artificielle pour intégrer l’IA avec conscience, légalité et intelligence humaine.

✅ Adaptée aux équipes RH, DSI, direction générale et managers

✅ Axée sur la conformité, la gouvernance et la responsabilité

✅ Formation opérationnelle, animée par des experts droit + IA

Ne laissez pas vos IA travailler dans l’ombre. Donnez-leur un cadre éthique et juridique solide… et reprenez les commandes.